NVIDIA ConnectX-6 MCX653105A-HDAT 200Gb / s Single-Port InfiniBand Smart Adapter với mã hóa phần cứng & PCIe 4.0

Thông tin chi tiết sản phẩm:

| Hàng hiệu: | Mellanox |

| Số mô hình: | MCX653105A-HDAT |

| Tài liệu: | connectx-6-infiniband.pdf |

Thanh toán:

| Số lượng đặt hàng tối thiểu: | 1 cái |

|---|---|

| Giá bán: | Negotiate |

| chi tiết đóng gói: | hộp bên ngoài |

| Thời gian giao hàng: | Dựa trên hàng tồn kho |

| Điều khoản thanh toán: | T/T |

| Khả năng cung cấp: | Cung cấp theo dự án/đợt |

|

Thông tin chi tiết |

|||

| tình trạng sản phẩm: | Cổ phần | Ứng dụng: | Máy chủ |

|---|---|---|---|

| Tình trạng: | Mới và nguyên bản | Kiểu: | Có dây |

| Tốc độ tối đa: | Lên đến 200 GB/s | Đầu nối Ethernet: | QSFP56 |

| Người mẫu: | MCX653105A-HDAT | ||

| Làm nổi bật: | NVIDIA ConnectX-6 Infiniband adapter,Thẻ mạng 200Gb/s PCIe 4.0,Bộ chuyển đổi InfiniBand với mã hóa phần cứng |

||

Mô tả sản phẩm

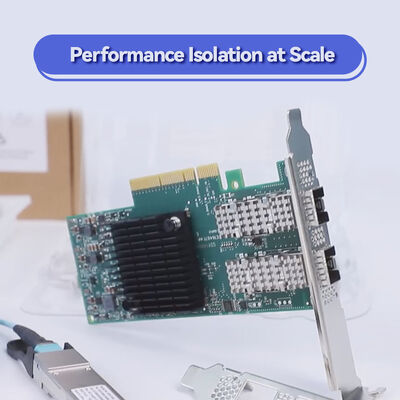

Adapter thông minh HDR đơn cổng 200Gb / s với điện toán trong mạng và mã hóa phần cứng

NVIDIA ConnectX-6MCX653105A-HDATcung cấp tốc độ thông lượng 200Gb / s đầy đủ trên một cổng QSFP56 duy nhất, kết hợp độ trễ cực thấp, tải phần cứng và mã hóa XTS-AES cấp khối. Được thiết kế cho HPC, cụm AI và lưu trữ NVMe-oF,PCIe 4 này.0 x16 adapter giảm tải các hoạt động tập thể, RDMA và mã hóa từ CPU, tối đa hóa hiệu suất ứng dụng và khả năng mở rộng trong môi trường trung tâm dữ liệu đòi hỏi.

CácMCX653105A-HDATthuộc về gia đình NVIDIA ConnectX-6 InfiniBand adapter, được thiết kế cho hiệu suất cực cao trong các trung tâm dữ liệu hiện đại.200Gb/s(HDR InfiniBand hoặc 200GbE) với tăng tốc phần cứng đầy đủ cho RDMA, vận chuyển đáng tin cậy và điện toán trong mạng.và NVMe trên gia tốc Fabrics, bộ chuyển đổi giảm đáng kể chi phí CPU trong khi tăng hiệu quả của vải.làm cho nó lý tưởng cho các dịch vụ tài chính, nghiên cứu của chính phủ, và triển khai đám mây siêu quy mô.

Tối đa 200Gb/s (HDR InfiniBand / 200GbE) trên một QSFP56

Tối đa 215 triệu tin nhắn/giây

XTS-AES 256/512 bit cấp khối, phù hợp với FIPS

Tải tải tập thể, NVMe-oF mục tiêu / khởi động tải, bộ đệm bùng nổ

PCIe Gen 4.0 / 3.0 x16 (hợp tác ngược)

SR-IOV (1K VFs), ASAP2, mở vSwitch thả tải, đường hầm chồng lên

Hỗ trợ RoCE, XRC, DCT, On-Demand Paging, GPUDirect RDMA

Đứng PCIe hồ sơ thấp, hỗ trợ cao được cài đặt sẵn + hỗ trợ ngắn bao gồm

NVIDIA ConnectX-6 tích hợpMáy tính trong mạngĐộng cơ tăng tốc giải phóng các hoạt động trung tâm dữ liệu quan trọng từ CPU chủ. MCX653105A-HDAT hỗ trợ giao thông đáng tin cậy dựa trên phần cứng, định tuyến thích nghi và kiểm soát tắc nghẽn,đảm bảo hiệu suất dự đoán trong vải quy mô lớn.Truy cập trực tiếp bộ nhớ từ xa (RDMA)cho phép chuyển dữ liệu không sao chép, bỏ qua lõi hệ điều hành.NVIDIA GPUDirect RDMA, bộ nhớ GPU giao tiếp trực tiếp với bộ chuyển đổi mạng, cắt giảm độ trễ cho đào tạo AI và mô phỏng HPC.mã hóa XTS-AES cấp khối(256/512-bit key) đảm bảo an ninh dữ liệu trong quá trình và dữ liệu trong trạng thái nghỉ mà không có chi phí CPU, và bộ chuyển đổi được thiết kế để đáp ứng các yêu cầu tuân thủ FIPS 140-2.

- Máy tính hiệu suất cao (HPC):Mô phỏng quy mô lớn, dự báo thời tiết và động lực học chất lỏng tính toán đòi hỏi kết nối với độ trễ thấp 200Gb / s.

- AI & Deep Learning Cluster:Đào tạo phân tán với GPUDirect RDMA, tối đa hóa thông lượng giữa các nút GPU.

- Hệ thống lưu trữ NVMe-oF:Lưu trữ phân chia hiệu suất cao với tải trọng mục tiêu / khởi tạo đầy đủ, giảm việc sử dụng CPU.

- Trung tâm dữ liệu siêu quy mô và đám mây:Môi trường ảo hóa với SR-IOV, mạng phủ trên và mã hóa tăng tốc phần cứng.

- Các nền tảng giao dịch tài chính:Mạng lưới xác định độ trễ cực thấp cho giao dịch thuật toán.

ConnectX-6 MCX653105A-HDAT tương tác liền mạch với NVIDIA Quantum InfiniBand switch (HDR 200Gb / s), switch 200GbE tiêu chuẩn và một loạt các nền tảng máy chủ.Nó hỗ trợ các hệ điều hành chính và ngăn xếp ảo hóa, đảm bảo tích hợp linh hoạt vào cơ sở hạ tầng hiện có.

| Parameter | Thông số kỹ thuật |

|---|---|

| Mô hình sản phẩm | MCX653105A-HDAT |

| Tỷ lệ dữ liệu | 200Gb/s, 100Gb/s, 50Gb/s, 40Gb/s, 25Gb/s, 10Gb/s, 1Gb/s (InfiniBand và Ethernet) |

| Cổng & Kết nối | 1x QSFP56 (hỗ trợ đồng thụ động, quang hoạt động và cáp AOC) |

| Giao diện máy chủ | PCIe Gen 4.0 x16 (cũng tương thích với Gen 3.0, 2.0; hỗ trợ các cấu hình x8, x4, x2, x1) |

| Độ trễ | Sub-microsecond (thường < 0,7μs) |

| Tỷ lệ tin nhắn | Tối đa 215 triệu tin nhắn mỗi giây |

| Mã hóa | XTS-AES 256/512 bit phần cứng tải, FIPS 140-2 sẵn sàng |

| Hình thức yếu tố | PCIe stand-up có hồ sơ thấp (được cài đặt sẵn khoang cao, bao gồm phụ kiện khoang ngắn) |

| Kích thước (không có đệm) | 167.65mm x 68.90mm |

| Tiêu thụ năng lượng | Thông thường 22W ∼ 24W (tùy thuộc vào việc sử dụng liên kết) |

| Virtualization | SR-IOV (lên đến 1K Virtual Functions), VMware NetQueue, NPAR, ASAP2 flow offload |

| Quản lý và giám sát | NC-SI, MCTP qua PCIe/SMBus, PLDM (DSP0248, DSP0267), I2C, SPI flash |

| Remote Boot | InfiniBand, iSCSI, PXE, UEFI |

| Hệ điều hành | RHEL, SLES, Ubuntu, Windows Server, FreeBSD, VMware vSphere, OpenFabrics Enterprise Distribution (OFED), WinOF-2 |

| Số phần đặt hàng (OPN) | Các cảng | Tốc độ tối đa | Giao diện máy chủ | Các đặc điểm chính |

|---|---|---|---|---|

| MCX653105A-HDAT | 1x QSFP56 | 200Gb/s | PCIe 3.0/4.0 x16 | Cổng duy nhất, mã hóa phần cứng, tải hết ConnectX-6, lý tưởng cho máy chủ mật độ cao |

| MCX653106A-HDAT | 2x QSFP56 | 200Gb/s (hai cổng) | PCIe 3.0/4.0 x16 | Cổng kép 200Gb/s với mật mã, mật độ băng thông tối đa |

| MCX653105A-ECAT | 1x QSFP56 | 100Gb/s | PCIe 3.0/4.0 x16 | Cổng duy nhất 100Gb / s, tối ưu hóa chi phí cho các yêu cầu tốc độ thấp hơn |

| MCX653106A-ECAT | 2x QSFP56 | 100Gb/s (hai cổng) | PCIe 3.0/4.0 x16 | Cổng kép 100Gb / s, ảo hóa & lưu trữ tải |

| MCX653436A-HDAT (OCP 3.0) | 2x QSFP56 | 200Gb/s | PCIe 3.0/4.0 x16 | OCP 3.0 small form factor, hai cổng 200Gb/s |

- Bandwidth 200Gb/s đầy đủ:Thiết kế cổng duy nhất cung cấp thông lượng tối đa cho các nút tính toán nơi mật độ cao trên mỗi cổng được ưu tiên.

- Bảo mật phần cứng tích hợp:Mã hóa khối XTS-AES mà không có chi phí CPU, đáp ứng sự tuân thủ FIPS cho các ngành được quy định.

- Lưu trữ tăng tốc & AI:NVMe-oF offloads và GPUDirect RDMA tăng hiệu suất đáng kể cho đào tạo AI và lưu trữ được xác định bởi phần mềm.

- PCIe sẵn sàng tương lai 4.0:Tăng gấp đôi băng thông kết nối với máy chủ, loại bỏ các nút thắt cho mạng 200Gb / s.

- Quản lý đơn giản:Đầy trình điều khiển thống nhất (OFED, WinOF-2) và khả năng tương thích OS rộng giảm sự phức tạp của việc triển khai.

Nhóm Hong Kong Starsurge cung cấp hỗ trợ kỹ thuật chuyên gia, bảo hành bảo hành, và dịch vụ RMA toàn cầu cho tất cả các NVIDIA ConnectX adapters.điều chỉnh hiệu suấtChúng tôi cung cấp giá cả linh hoạt, báo giá hàng loạt cho các dự án trung tâm dữ liệu, và vận chuyển nhanh trên toàn thế giới.liên hệ với đội ngũ bán hàng của chúng tôi để thảo luận về thời gian giao hàng và giảm giá khối lượng.

• Kiểm tra khe cắm PCIe cung cấp đủ điện (75W từ khe cắm; bộ điều hợp tiêu thụ ~ 22-24W điển hình).

• Đối với nền tảng làm mát bằng chất lỏng, thẻ làm mát bằng không khí tiêu chuẩn này không tương thích với các biến thể đĩa lạnh; liên hệ Starsurge cho nhu cầu SKU làm mát bằng chất lỏng.

• Luôn sử dụng cáp hoặc mô-đun được xếp hạng QSFP56 để đạt hiệu suất 200Gb / s.

• Xác nhận khả năng tương thích phiên bản trình điều khiển với hệ điều hành và kernel của bạn trước khi triển khai.

Kể từ năm 2008, Hong Kong Starsurge Group Co., Limited là một nhà cung cấp đáng tin cậy về phần cứng mạng doanh nghiệp, tích hợp hệ thống và dịch vụ CNTT.Là đối tác được ủy quyền cho các giải pháp mạng NVIDIAStarsurge cung cấp các bộ điều hợp, công tắc và cáp ConnectX chính hãng cho các khách hàng chính phủ, tài chính, y tế, giáo dục và siêu quy mô trên toàn thế giới.Các đội bán hàng và kỹ thuật có kinh nghiệm của chúng tôi đảm bảo triển khai liền mạch từ kiến trúc trước bán hàng đến hỗ trợ sau bán hàng, với cam kết về chất lượng đáng tin cậy và dịch vụ đáp ứng.

Phân phối toàn cầu · Hỗ trợ đa ngôn ngữ · Dịch vụ OEM & tích hợp phù hợp

| Thành phần / Hệ sinh thái | Tình trạng hỗ trợ | Nhận xét |

|---|---|---|

| NVIDIA Quantum HDR InfiniBand Switch | ✓ Được hỗ trợ đầy đủ | Vải 200Gb/s, định tuyến thích nghi |

| Chuyển đổi 200GbE (IEEE 802.3) | ✓ Phù hợp | Yêu cầu chế độ FEC cho từng thông số kỹ thuật chuyển đổi |

| GPU Direct RDMA | ✓ Có | Dòng GPU NVIDIA (Volta, Ampere, Hopper, v.v.) |

| VMware vSphere 7.0/8.0 | ✓ Chứng nhận | Người lái xe bản địa, hỗ trợ SR-IOV |

| Linux (RHEL, Ubuntu, SLES) | ✓ Hỗ trợ đầy đủ | MLNX_OFED, trình điều khiển hộp thư đến có sẵn |

| Windows Server 2019/2022 | ✓ Được hỗ trợ | Gói trình điều khiển WinOF-2 |

- [ ] Xác nhận tốc độ liên kết cần thiết: 200Gb / s cổng đơn phù hợp với yêu cầu băng thông nút của bạn.

- [ ] Kiểm tra khe cắm máy chủ PCIe: khe cắm vật lý x16, Gen 4 được khuyến cáo cho hiệu suất 200Gb / s đầy đủ.

- [ ] Chọn các cáp hoặc máy thu QSFP56 thích hợp (bốm thụ động lên đến 5m, AOC hoặc quang học).

- [ ] Kiểm tra hỗ trợ trình điều khiển hệ điều hành (phiên bản OFED hoặc hộp thư đến).

- [ ] Đảm bảo tuân thủ các yêu cầu về mã hóa (XTS-AES, FIPS).

- [ ] Đánh giá hệ thống làm mát môi trường: các bộ điều hợp tốc độ cao có thể yêu cầu dòng không khí hướng.