NVIDIA MCX555A-ECAT 100Gb/s Cổng đơn QSFP28 InfiniBand Adapter PCIe 3.0 x16 ConnectX-5 Thẻ mạng

Thông tin chi tiết sản phẩm:

| Hàng hiệu: | Mellanox |

| Số mô hình: | MCX555A-ECAT |

| Tài liệu: | CONNECTX-5 infiniband.pdf |

Thanh toán:

| Số lượng đặt hàng tối thiểu: | 1 cái |

|---|---|

| Giá bán: | Negotiate |

| chi tiết đóng gói: | hộp bên ngoài |

| Thời gian giao hàng: | Dựa trên hàng tồn kho |

| Điều khoản thanh toán: | T/T |

| Khả năng cung cấp: | Cung cấp theo dự án/đợt |

|

Thông tin chi tiết |

|||

| tình trạng sản phẩm: | Cổ phần | Ứng dụng: | Máy chủ |

|---|---|---|---|

| Tình trạng: | Mới và nguyên bản | Kiểu: | Có dây |

| Tốc độ tối đa: | EDR và 100GBE | Đầu nối Ethernet: | QSFP28 |

| Làm nổi bật: | NVIDIA ConnectX-5 InfiniBand adapter,Thẻ mạng 100Gb/s QSFP28,Thẻ PCIe 3.0 x16 Mellanox |

||

Mô tả sản phẩm

Card mạng hiệu suất cao, độ trễ thấp 100Gb/s được thiết kế cho các trung tâm dữ liệu HPC, AI và đám mây. Tích hợp các tính năng offload tiên tiến bao gồm NVMe qua Fabrics, GPUDirect RDMA và khớp thẻ cho các tác vụ MPI — mang lại thông lượng hàng đầu ngành và hiệu quả CPU.

Card mạng NVIDIA ConnectX-5 MCX555A-ECAT là card mạng InfiniBand cổng đơn 100Gb/s dạng PCIe cấu hình thấp. Tận dụng kiến trúc ConnectX-5 đã được chứng minh, card mang lại thông lượng lên đến 100Gb/s với độ trễ dưới micro giây và tốc độ truyền tin nhắn cao. Card hỗ trợ cả InfiniBand (lên đến EDR) và 100GbE, cung cấp kết nối linh hoạt cho các môi trường máy tính hiệu suất cao, lưu trữ và ảo hóa.

Được tích hợp bộ chuyển mạch PCIe và các khả năng RDMA tiên tiến, MCX555A-ECAT giảm tải các tác vụ giao tiếp quan trọng khỏi CPU — cho phép hiệu suất ứng dụng cao hơn, tiêu thụ điện năng thấp hơn và giảm tổng chi phí sở hữu. Card hoàn toàn tương thích với các khe cắm PCIe 3.0 x16 và hỗ trợ nhiều hệ điều hành và framework tăng tốc.

- Kết nối lên đến 100Gb/s trên mỗi cổng (InfiniBand EDR / 100GbE)

- Đầu nối QSFP28 đơn cho cáp quang hoặc cáp đồng

- Giao diện máy chủ PCIe 3.0 x16 (tự động đàm phán thành x8, x4, x2, x1)

- RDMA, ngữ nghĩa gửi/nhận với truyền tải đáng tin cậy dựa trên phần cứng

- Khớp thẻ và offload rendezvous cho MPI và SHMEM

- Offload đích NVMe qua Fabrics (NVMe-oF) cho lưu trữ hiệu quả

- Tăng tốc GPUDirect RDMA (PeerDirect) cho giao tiếp GPU

- Kiểm soát tắc nghẽn dựa trên phần cứng & hỗ trợ định tuyến thích ứng

- Ảo hóa SR-IOV: lên đến 512 chức năng ảo

- Tuân thủ RoHS, dạng yếu tố cấu hình thấp (bao gồm giá đỡ cao)

Kiến trúc ConnectX-5 tích hợp một loạt các bộ tăng tốc phần cứng giúp giảm sự can thiệp của CPU và cải thiện khả năng mở rộng của ứng dụng:

- Khớp thẻ MPI & Offload Rendezvous: Giảm tải việc khớp tin nhắn và xử lý giao thức rendezvous, cải thiện đáng kể hiệu suất MPI cho các cụm HPC.

- RDMA ngoài thứ tự với Định tuyến thích ứng: Cho phép sử dụng hiệu quả nhiều đường mạng trong khi vẫn duy trì ngữ nghĩa hoàn thành theo thứ tự, tối đa hóa việc sử dụng fabric.

- Offload đích NVMe-oF: Cho phép các hệ thống lưu trữ NVMe phục vụ truy cập từ xa với chi phí CPU gần như bằng không, lý tưởng cho các kiến trúc lưu trữ phân tán.

- Transport Kết nối Động (DCT): Cung cấp khả năng mở rộng cực cao cho các hệ thống tính toán và lưu trữ lớn bằng cách loại bỏ chi phí thiết lập kết nối.

- ASAP2 Tăng tốc Chuyển mạch & Xử lý Gói tin: Offload phần cứng cho Open vSwitch (OVS) và đường hầm mạng phủ (VXLAN, NVGRE, GENEVE).

- Phân trang theo yêu cầu (ODP): Hỗ trợ phân trang bộ nhớ ảo cho các hoạt động RDMA, đơn giản hóa việc phát triển ứng dụng.

- Tính toán hiệu suất cao (HPC): Lý tưởng cho các cụm siêu máy tính, mô phỏng dựa trên MPI và các tác vụ nghiên cứu khoa học yêu cầu độ trễ thấp và tốc độ tin nhắn cao.

- Huấn luyện AI & Học sâu: Kết hợp với GPUDirect RDMA, cho phép giao tiếp GPU-GPU nhanh chóng giữa các nút, tăng tốc thời gian huấn luyện.

- Hệ thống lưu trữ NVMe-oF: Triển khai làm đích hoặc bộ khởi tạo lưu trữ trong môi trường NVMe qua Fabrics để truy cập lưu trữ khối có thông lượng cao, độ trễ thấp.

- Trung tâm dữ liệu đám mây & ảo hóa: Các offload SR-IOV và ảo hóa hỗ trợ môi trường đa người thuê với QoS được đảm bảo và cô lập an toàn.

- Giao dịch tần suất cao (HFT): Độ trễ cực thấp và đóng dấu thời gian phần cứng (IEEE 1588v2) đáp ứng nhu cầu của các ứng dụng dịch vụ tài chính.

MCX555A-ECAT được thiết kế để tương thích rộng rãi với các switch InfiniBand của NVIDIA (ví dụ: Quantum, Spectrum) và các switch 100GbE của bên thứ ba. Card hỗ trợ cả cáp DAC đồng thụ động và cáp quang chủ động thông qua các cổng QSFP28.

Hệ điều hành & Bộ phần mềm:

- RHEL / CentOS, Ubuntu, Windows Server, FreeBSD, VMware ESXi

- OpenFabrics Enterprise Distribution (OFED) / WinOF-2

- NVIDIA HPC-X, OpenMPI, MVAPICH2, Intel MPI, Platform MPI

- Bộ phát triển mặt phẳng dữ liệu (DPDK) cho bỏ qua kernel

| Thông số | Thông số kỹ thuật |

|---|---|

| Mẫu | MCX555A-ECAT |

| Yếu tố hình thức | PCIe cấu hình thấp (14,2cm x 6,9cm không có giá đỡ), giá đỡ cao được lắp sẵn, giá đỡ ngắn đi kèm |

| Tốc độ & Loại cổng | 1x QSFP28, InfiniBand (EDR) và 100GbE lên đến 100Gb/s |

| Giao diện máy chủ | PCI Express 3.0 x16 (tương thích với x8, x4, x2, x1) |

| Hỗ trợ InfiniBand | Tuân thủ IBTA 1.3, EDR 100Gb/s, FDR, QDR, DDR, SDR; 8 làn ảo + VL15; 16 triệu kênh I/O |

| Hỗ trợ Ethernet | 100GbE, 50GbE, 40GbE, 25GbE, 10GbE, 1GbE; IEEE 802.3cd, 802.3bj, 802.3by, 802.3ba, 802.3ae |

| Khả năng RDMA | RDMA qua Ethernet hội tụ (RoCE), truyền tải đáng tin cậy bằng phần cứng, RDMA ngoài thứ tự, các phép toán nguyên thủy |

| Offload lưu trữ | Offload đích NVMe qua Fabrics, iSER, SRP, NFS RDMA, SMB Direct, chuyển giao chữ ký T10 DIF |

| Ảo hóa | SR-IOV (lên đến 512 chức năng ảo), VMware NetQueue, NPAR, Dịch vụ kiểm soát truy cập PCIe (ACS) |

| Offload CPU | Offload trạng thái tĩnh TCP/UDP/IP, LSO/LRO, offload checksum, RSS/TSS, chèn/xóa thẻ VLAN/MPLS |

| Mạng phủ | Offload phần cứng cho đóng gói/giải nén VXLAN, NVGRE, GENEVE |

| Quản lý | NC-SI qua MCTP, PLDM để giám sát/điều khiển và cập nhật firmware, I2C, SPI, JTAG |

| Khởi động từ xa | Khởi động từ xa qua InfiniBand, Ethernet, iSCSI; hỗ trợ UEFI, PXE |

| Tiêu thụ điện năng | Không được chỉ định công khai; phạm vi điển hình dưới 20W — vui lòng xác nhận cho hệ thống của bạn |

| Nhiệt độ hoạt động | 0°C đến 55°C (môi trường điển hình) |

| Tuân thủ | RoHS, REACH, FCC, CE, VCCI, ICES, RCM |

Lưu ý: Thông số kỹ thuật được lấy từ tài liệu sản phẩm NVIDIA ConnectX-5. Để biết chi tiết mới nhất và hỗ trợ firmware, vui lòng tham khảo ghi chú phát hành chính thức của NVIDIA.

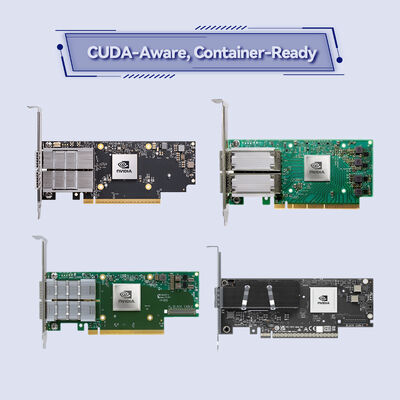

| Số hiệu đặt hàng | Cổng / Tốc độ | Giao diện máy chủ | Yếu tố hình thức | Các tính năng chính |

|---|---|---|---|---|

| MCX555A-ECAT | 1x QSFP28, 100Gb/s | PCIe 3.0 x16 | PCIe cấu hình thấp | Đơn cổng tiêu chuẩn, InfiniBand EDR / 100GbE |

| MCX556A-ECAT | 2x QSFP28, 100Gb/s | PCIe 3.0 x16 | PCIe cấu hình thấp | Kép cổng, EDR/100GbE |

| MCX556A-EDAT | 2x QSFP28, 100Gb/s | PCIe 4.0 x16 | PCIe cấu hình thấp | ConnectX-5 Ex, PCIe Gen4 nâng cao |

| MCX556M-ECAT-S25 | 2x QSFP28, 100Gb/s | 2x PCIe 3.0 x8 | Socket Direct | Kết nối máy chủ kép qua dây cáp |

| MCX545B-ECAN | 1x QSFP28, 100Gb/s | PCIe 3.0 x16 | OCP 2.0 Loại 1 | Yếu tố hình thức Open Compute Project |

Đối với các biến thể OCP hoặc Multi-Host, vui lòng liên hệ bộ phận bán hàng. Tất cả các card đều hỗ trợ khả năng tương thích ngược với tốc độ thấp hơn.

- Hiệu suất ứng dụng vượt trội: Các offload phần cứng cho MPI, NVMe-oF và mạng phủ giải phóng các lõi CPU cho logic nghiệp vụ.

- Fabric RDMA có thể mở rộng: DCT, XRC và RDMA ngoài thứ tự mang lại khả năng mở rộng tuyến tính cho hàng nghìn nút.

- Sẵn sàng tăng tốc GPU: GPUDirect RDMA cho phép truy cập bộ nhớ trực tiếp giữa các GPU và card mạng, loại bỏ các nút thắt cổ chai CPU trong các cụm AI.

- Triển khai linh hoạt: Cổng QSFP28 đơn giản hóa việc đi dây và lý tưởng cho các kiến trúc leaf-spine 100Gb/s.

- Bảo vệ đầu tư: Hỗ trợ cả InfiniBand và Ethernet cho phép chuyển đổi liền mạch giữa các giao thức khi nhu cầu thay đổi.

Hong Kong Starsurge Group cung cấp hỗ trợ toàn diện vòng đời cho các card mạng NVIDIA ConnectX-5, bao gồm hỗ trợ cấu hình trước bán hàng, hướng dẫn cập nhật firmware và dịch vụ bảo hành. Đội ngũ kỹ thuật của chúng tôi có thể hỗ trợ với:

- Xác minh khả năng tương thích với cơ sở hạ tầng máy chủ và switch của bạn

- Tinh chỉnh hiệu suất cho các tác vụ HPC hoặc lưu trữ

- Các tùy chọn giá đỡ tùy chỉnh và yêu cầu đóng gói số lượng lớn

- Xử lý RMA và các dịch vụ thay thế nâng cao

Liên hệ với các kỹ sư bán hàng của chúng tôi để biết thông tin về giá số lượng lớn và thời gian giao hàng.

Xả tĩnh điện (ESD): Luôn sử dụng các biện pháp an toàn ESD khi xử lý card mạng. Bảo quản trong bao bì chống tĩnh điện cho đến khi lắp đặt. Yêu cầu làm mát: Đảm bảo luồng không khí đầy đủ trong khung máy chủ để duy trì nhiệt độ hoạt động trong phạm vi quy định. Cập nhật Firmware: Sử dụng các công cụ firmware chính thức của NVIDIA (MFT) và xác minh khả năng tương thích với phiên bản HĐH và trình điều khiển của bạn trước khi cập nhật. Uốn cong cáp: Tuân thủ các hướng dẫn về bán kính uốn cong của cáp QSFP28 để tránh suy giảm tín hiệu.

Đây là sản phẩm Loại A. Trong môi trường dân cư, nó có thể gây nhiễu sóng vô tuyến. Đảm bảo che chắn và nối đất thích hợp theo quy định của địa phương.

Được thành lập vào năm 2008, Hong Kong Starsurge Group Co., Limited là nhà cung cấp các giải pháp phần cứng mạng, dịch vụ CNTT và tích hợp hệ thống dựa trên công nghệ. Phục vụ khách hàng trên toàn thế giới với các sản phẩm bao gồm switch mạng, card mạng, điểm truy cập không dây, bộ điều khiển và cáp tốc độ cao, Starsurge kết hợp chuyên môn kỹ thuật sâu với cách tiếp cận ưu tiên khách hàng. Công ty hỗ trợ các ngành như chính phủ, y tế, sản xuất, giáo dục, tài chính và doanh nghiệp, cung cấp các giải pháp IoT, hệ thống quản lý mạng, phát triển phần mềm tùy chỉnh và phân phối toàn cầu đa ngôn ngữ. Với trọng tâm là chất lượng đáng tin cậy và dịch vụ phản hồi nhanh, Starsurge giúp khách hàng xây dựng cơ sở hạ tầng mạng hiệu quả, có thể mở rộng và đáng tin cậy.

| Thành phần / Hệ thống | Trạng thái tương thích | Ghi chú |

|---|---|---|

| Switch InfiniBand NVIDIA Quantum | Đã chứng nhận | Tương thích EDR, HDR khi sử dụng firmware phù hợp |

| Switch Ethernet NVIDIA Spectrum | Đã chứng nhận | Hỗ trợ các chế độ 100GbE, 50GbE, 25GbE |

| Switch 100GbE của bên thứ ba | Tương thích | Yêu cầu tuân thủ tiêu chuẩn IEEE; đã thử nghiệm với các nhà cung cấp lớn |

| Máy chủ GPU (NVIDIA DGX, HGX) | Đã chứng nhận với GPUDirect | Tăng tốc RDMA cho giao tiếp đa GPU |

| Hệ thống lưu trữ với NVMe-oF | Được hỗ trợ | Offload đích cho phép truy cập fabric NVMe hiệu quả |

- ☑ Xác nhận máy chủ có khe cắm PCIe 3.0 x16 (hoặc x8) khả dụng với khoảng trống phù hợp.

- ☑ Xác định số lượng cổng: cổng đơn (MCX555A-ECAT) so với cổng kép (MCX556A-ECAT).

- ☑ Chọn loại cáp: cáp DAC đồng thụ động cho khoảng cách ngắn (≤5m) hoặc cáp quang cho các đường chạy dài hơn.

- ☑ Xác minh hỗ trợ hệ điều hành và trình điều khiển (OFED, Windows, VMware).

- ☑ Đối với các cụm GPU, đảm bảo khả năng tương thích GPUDirect RDMA với mẫu GPU và phiên bản trình điều khiển của bạn.

- ☑ Kiểm tra xem giá đỡ cao hay thấp có cần thiết cho khung máy chủ của bạn không.

- NVIDIA MCX556A-ECAT — Card ConnectX-5 cổng kép 100Gb/s

- NVIDIA MCX556A-EDAT — ConnectX-5 Ex với hỗ trợ PCIe 4.0

- Switch InfiniBand NVIDIA Quantum-2 QM9700 40 cổng 800Gb/s

- Cáp DAC thụ động Mellanox QSFP28 (1m, 2m, 3m)

- Switch Ethernet NVIDIA Spectrum-4 SN5600 100GbE/400GbE

- Hướng dẫn sử dụng Card mạng InfiniBand NVIDIA ConnectX-5

- Hướng dẫn triển khai RDMA qua Ethernet hội tụ (RoCE)

- Các phương pháp hay nhất về GPUDirect RDMA cho các cụm AI

- NVMe qua Fabrics với ConnectX-5 — Hướng dẫn cấu hình

- Hướng dẫn cài đặt và tinh chỉnh OFED